Yapay Zeka Sunucularında top_p Parametresinin Stratejik Kullanımı ve Çıktı Kalitesine Etkisi

Yapay zeka modelleriyle çalışan GPU tabanlı özel sunucular, yalnızca donanım gücü ile değil, inference (çıkarım) aşamasında kullanılan ayarlarla da sonuçların kalitesini belirler. Bu ayarlardan biri olan top_p parametresi, özellikle metin üreten modellerde (LLM – Large Language Models) üretilecek çıktının çeşitliliğini ve tutarlılığını doğrudan etkileyen kritik bir hiperparametredir. Ancak kitlesel bulut servislerinde bu parametreyi optimize etme yeteneğiniz sınırlı olabilir; kontrol sizde değil, platformun ön tanımlı değerlerinde kalırsınız. Bu da hem çıktı kalitesini hem de stratejik veri kullanımını riske atar.

top_p Nedir ve Nasıl Çalışır?

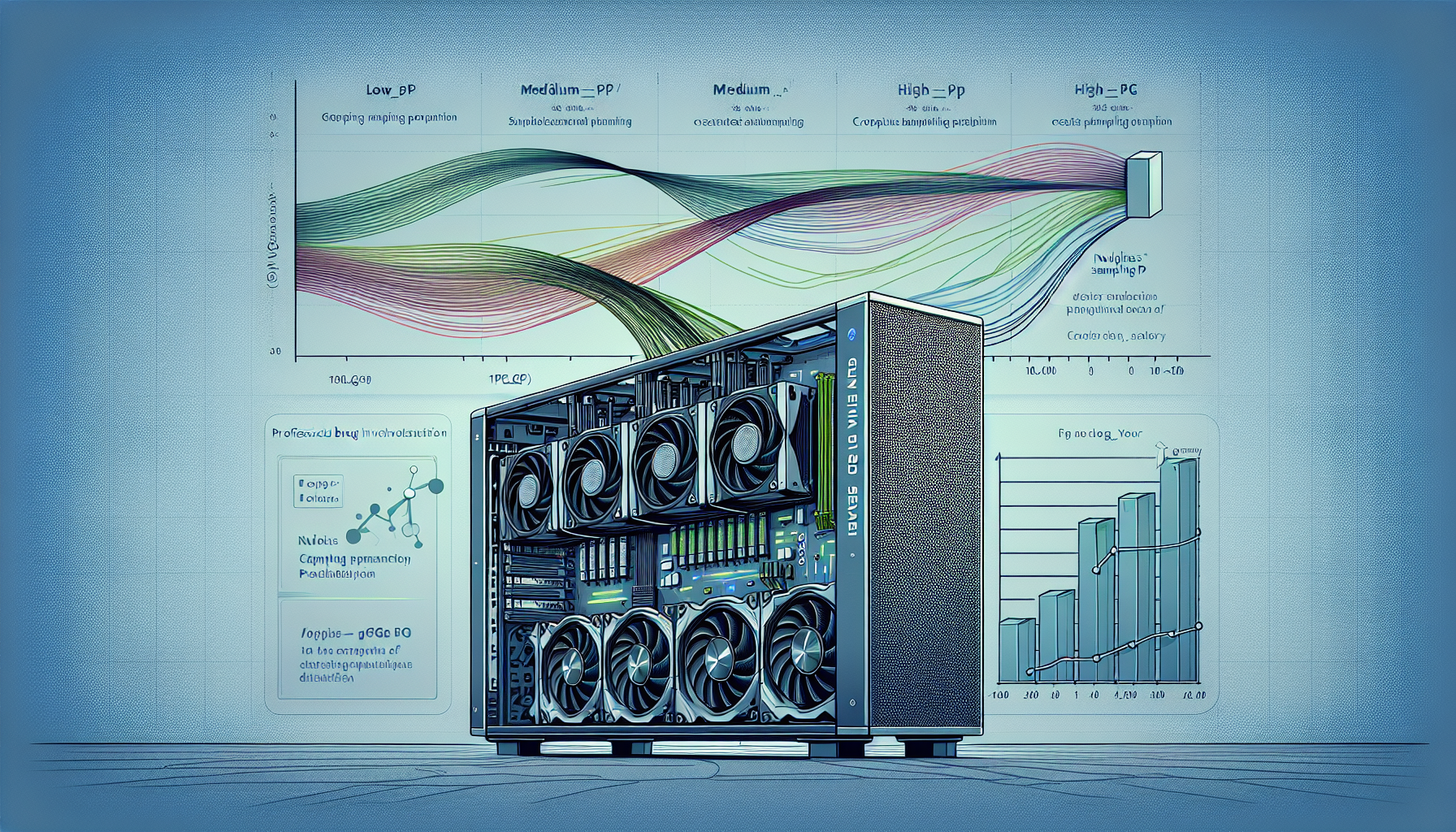

top_p parametresi, nucleus sampling olarak bilinen bir olasılık tabanlı seçim yönteminin kontrol anahtarıdır. Modelin olası kelime veya token çıkışlarını sıralayan olasılık dağılımında, top_p değeri bir eşik belirler. Örneğin:

– top_p = 0.9 → Model, olasılık toplamı %90’a ulaşana kadar en olası token’ları seçer ve geri kalan düşük olasılıklıları dışarıda bırakır.

– top_p = 1.0 → Tüm olasılık havuzu dahil edilir, çeşitlilik artar fakat tutarlılık azalabilir.

– top_p = 0.5 → Çıktı daha tahmin edilebilir olur, ancak yaratıcılık ve varyasyon düşer.

Bu parametre, VRAM kapasitesi, GPU çekirdek sayısı, ve model boyutu ile birlikte değerlendirildiğinde, inference süresini ve sonuç kalitesini optimize eden önemli bir bileşendir.

Kitlesel Servislerdeki Riskler

Çoğu paylaşımlı AI hizmetinde:

– top_p ayarına erişiminiz sınırlıdır.

– Modelin arka plandaki sampling mekanizması şeffaf değildir.

– Geliştirme ortamınızda denediğiniz değerler, üretim ortamında farklı sonuçlar verebilir.

Bu belirsizlik, özellikle özel veri setleriyle çalışan kurumlar için ciddi bir problem yaratır. Yanlış optimize edilmiş top_p, modelin kritik alanlarda (örneğin hukuki metin üretimi veya teknik dokümantasyon) tutarlılığını düşürür ve veri güvenliği açısından risk oluşturur.

Özel GPU Sunucusunda top_p Optimizasyonu

HatipTek’in tam kontrol sağlayan özel AI sunucuları, inference aşamasındaki tüm sampling parametrelerini yönetmenize izin verir:

– Modelin kendi konfigürasyon dosyasına doğrudan erişim: top_p ve temperature gibi ayarları gerçek zamanlı değiştirebilirsiniz.

– Yüksek VRAM ile büyük nucleus havuzunu işleme kapasitesi: Örneğin, 48 GB VRAM’li bir NVIDIA A6000 sunucu, hem düşük top_p ile tutarlı hem yüksek top_p ile yaratıcı metinleri hızlıca üretebilir.

– Performans izleme ve logging: Her top_p denemesinde modelin latency, token başına işlem süresi ve GPU yük verilerini kaydedebilir, en optimal noktayı bulabilirsiniz.

Stratejik Çıkarım

top_p parametresi, yalnızca teknik bir ayar değil; dijital egemenlik stratejisinde çıktı kontrolü anlamına gelir. Kendi GPU sunucunuzda çalıştığınızda, modelin davranışını istediğiniz doğruluk–yaratıcılık dengesine göre şekillendirirsiniz. Kitlesel servislerin ön tanımlı parametrelerine bağlı kalmak yerine, HatipTek’in özel altyapısıyla verinizi, modelinizi ve çıktınızı tamamen kontrol altında tutarsınız.

Teknolojiniz. Kontrolünüz Altında.

Yapay zeka altyapınızı ve inference parametrelerinizi tam kontrol altına almak için bizimle iletişime geçin: HatipTek İletişim

Bir yanıt yazın